GUERRA E PACE

Hello humans, ci eravamo lasciati la settimana scorsa sullo scontro Anthropic vs. Pentagono e sul filo rosso che lega l’AI alle guerre nel mondo. Poi è arrivata la verità sul bombardamento della scuola di Minab in Iran e quel filo rosso è diventato qualcos’altro. Ne parliamo oggi, e non solo di quello. Io sono Matteo Montan e se volete saperne di più su di me e su questa newsletter, trovate tutto nelle Info. Buona lettura.

I CIRCOLI VIZIOSI DELL’AI DI GUERRA

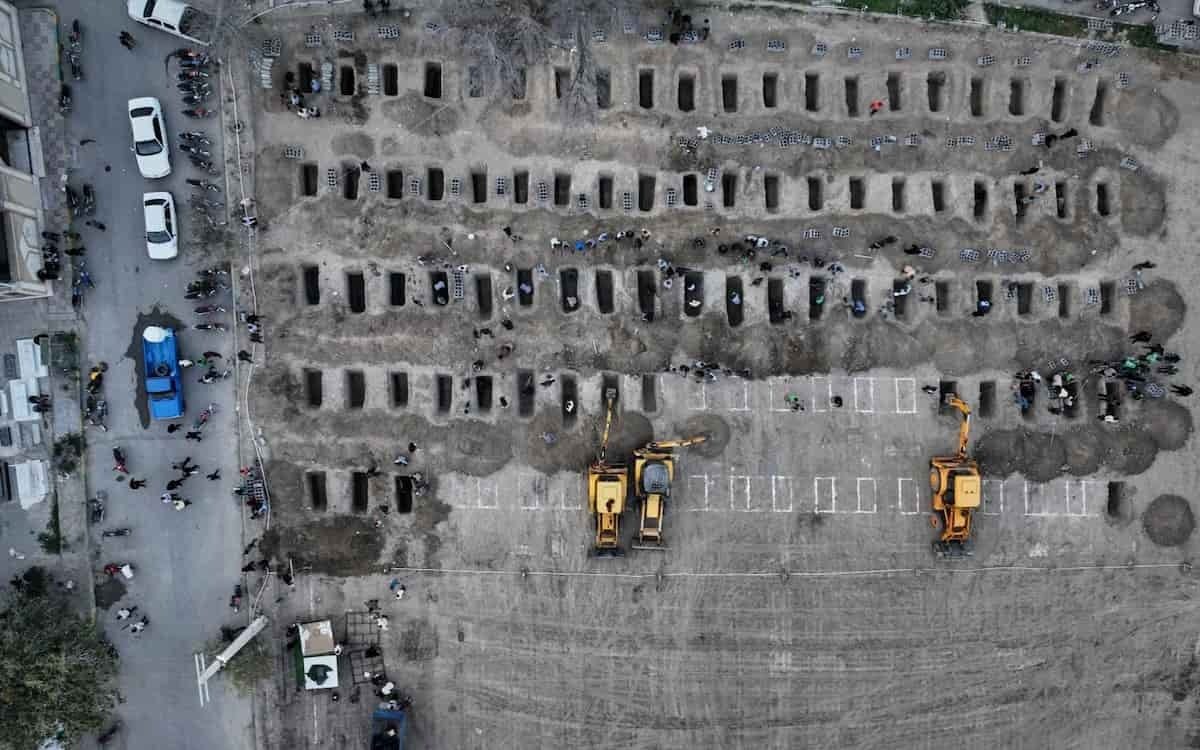

La scuola elementare Shajareh Tayyebeh di Minab è stata colpita il 28 febbraio da un missile Tomahawk. Almeno 175 morti, tra cui decine di bambine. L’edificio risultava nei database della Defense Intelligence Agency come parte di una base delle Guardie Rivoluzionarie, dalla quale era stato separato nel 2016. Dieci anni di dati non aggiornati, un missile che non sbaglia mai, e alle otto del mattino una scuola piena di bambine. Il ruolo dell’AI in questa storia resta una domanda aperta, ma non eludibile. Il sistema Claude di Anthropic, integrato nel Maven Smart System di Palantir e al centro dello scontro tra Amodei e il Pentagono, è stato confermato come strumento di selezione e prioritizzazione degli obiettivi nell’intera campagna iraniana. Sul caso specifico della scuola il Pentagono non ha né confermato né smentito. Craig Jones della Newcastle University ha messo il dito sulla piaga: non si può escludere che l’AI abbia classificato l’edificio come target militare basandosi su dati che nessuno si era preso la briga di aggiornare. Quando comprimi la catena decisionale affidando all’AI l’analisi di migliaia di obiettivi in poche ore, la verifica umana rischia di diventare una formalità e normale che un missile di precisione centri esattamente un edificio pieno di bambine alle otto del mattino. Che l’errore sia stato umano, dell’AI o di entrambi, il risultato è lo stesso. Ed è esattamente il tipo di scenario che Dario Amodei ha invocato spiegando al Pentagono perché l’AI non è ancora pronta per operare in autonomia: non perché non sia capace, ma perché quando qualcuno o qualcosa sbaglia le conseguenze sono irreversibili. Washington Post | CNN | Futurism

Che l’AI sia ormai protagonista assoluta delle guerre in corso è un fatto noto, il ruolo centrale che ha assunto nella più terribile delle attività umane è anch’esso uno dei segnali del punto di svolta che ha superato questa tecnologia ubiqua e onnipotente. La notizia della settimana è però che essa stessa è diventata un target. I droni delle Guardie Rivoluzionarie hanno colpito due data center di Amazon Web Services negli Emirati Arabi e danneggiato un terzo in Bahrain: servizi bancari, pagamenti e cloud in tilt in tutta la regione. Sono i primi attacchi fisici a infrastrutture di data center nella storia dei conflitti armati. L’Iran ha rivendicato l’operazione dichiarando di voler colpire il supporto alle operazioni militari americane, e ha pubblicato una lista di 29 ulteriori obiettivi — sedi di Amazon, Microsoft, Google, Palantir, Nvidia, Oracle e IBM dislocate nel Golfo. Il punto è che quei data center ospitano sia i server che fanno girare le app bancarie e la logistica civile che quelli che alimentano i sistemi AI che il Pentagono usa per il targeting in Iran. Colpirne uno significa colpire entrambi. Come ha osservato un analista del CSIS, i data center sono ormai obiettivi militari primari, e questo costringe l’intera industria a ripensare sicurezza fisica, scelta dei siti e miliardi di investimenti spesi nella regione del Golfo (per ora). The Guardian | Fortune | The Register

Nel circolo vizioso fatto di vittime e carnefici che si scambiano i ruoli, succede poi che la stessa AI che il Pentagono usa per selezionare i target in Iran è quella che lo porta in tribunale. Come promesso, Anthropic ha fatto causa al Dipartimento della Difesa impugnando davanti al tribunale federale di San Francisco la sua designazione di “supply chain risk”, etichetta sin qui riservata ad avversari stranieri ed usata per la prima volta contro un’azienda americana (il motivo dello scontro, lo ricordiamo, riguarda l’uso dell’AI nella sorveglianza di massa sui cittadini americani e nella gestione di armi letali autonome: il Pentagono voleva accesso a Claude anche per questi due casi, Anthropic ha detto no). La reazione dell’industria è stata senza precedenti: Microsoft, sempre più legata a Claude, ha depositato un brief a sostegno di Anthropic chiedendo al tribunale di sospendere la designazione. In parallelo, 37 dipendenti di OpenAI e Google DeepMind — tra cui il chief scientist di Google Jeff Dean — hanno firmato un proprio documento sostenendo che punire un’azienda per le sue posizioni sulla sicurezza avrebbe messo il bavaglio al dibattito sui rischi dell’AI. TechCrunch | The Hill | Fortune

DAGLI AGENTI MILITARI A QUELLI CIVILI

Prima che scoppiasse il conflitto in Iran - e con perfetta sincronia il caso Pentagono vs Anthropic sull’uso degli agenti AI in guerra - su questa newsletter avevo raccontato un post dietro l’altro come il punto di svolta dell’AI fosse avvenuto intorno alla fine dell’anno con il passaggio lento ma inesorabile dai chatbot agli agenti. All’inizio, ricorderete, c’era la sola Anthropic, prima con l’agente Claude Code e poi con l’agente Cowork, che con le sue capacità di operare al posto degli umani in task complessi legal e finance ha provocato un crollo senza precedenti dei titoli software a Wall Street. Giacomo Ciarlini nell’intervista di tre settimane fa sull’evoluzione dell’AI l’aveva messa così: “Presto o tardi tutti andranno a finire lì: un agente che lavora nel tuo computer.” E come previsto tra il 5 e il 10 marzo lì ci sono andati tutti.

Il 5 marzo OpenAI ha lanciato GPT-5.4, il suo primo modello general-purpose con capacità native di computer use — mouse, tastiera, screenshot — che su 44 professioni testate dice di eguagliare o superare i professionisti umani nell’83% dei casi. Il 9 marzo Microsoft ha risposto con Copilot Cowork, costruito in collaborazione con la stessa Anthropic e basato sullo stesso modello Claude, ma in cloud e integrato con l’intero ecosistema Microsoft 365: email, file, riunioni. Il giorno dopo Google ha potenziato Gemini in Docs, Sheets, Slides: con un singolo prompt l’AI genera documenti completi pescando dati da Gmail, Chat e Drive e trasformando lo storage passivo in una knowledge base attiva. Meta non ha lanciato il suo agente, ma ha acquisito Moltbook, il primo social network per agenti AI di cui avevamo parlato a lungo, diventato virale ma anche tristemente noto per le sue falle di sicurezza. I fondatori Matt Schlicht e Ben Parr entrano nel Meta Superintelligence Labs, Meta prende gli agenti social e li infila nel suo ecosistema, in mezzo a miliardi di utenti umani. Con quale intenzione esattamente, non si sa. OpenAI | Microsoft | Google | TechCrunch

ULTIME DAL FRONTE DEL LAVORO

Se tutti hanno un agente nel computer, la domanda che viene subito dopo è a chi portano via il lavoro. Il leggendario Peter Thiel, capo della Paypal maffia, ha dato una risposta interessante: l’AI colpirà prima chi lavora con i numeri (analisti, banker, programmatori) e solo dopo chi lavora con le parole. La ragione è che la matematica è un dominio chiuso e verificabile, ideale per l’automazione. I fatti per ora gli danno ragione, Bank of America, Wells Fargo, JPMorgan e Goldman Sachs hanno tutti confermato che l’AI permette di fare di più con meno persone, mentre crescono gli annunci di tech companies che cercano “storyteller” con le competenze narrative dei “word people”. Vuoi vedere che la famosa laurea in lettere…

A chi dice che l’AI cancellerà un’intera generazione ha risposto in modo autorevole IBM facendo l’opposto: ha triplicato le assunzioni di neolaureati. La CHRO Nickle LaMoreaux ne ha spiegato la logica: le aziende che investono adesso sui junior saranno le più competitive tra tre-cinque anni. Tagliare i giovani per risparmiare crea un buco nei quadri intermedi che poi costerà molto di più colmare. IBM ha riscritto così migliaia di job description per integrare AI e competenze umane: gli ingegneri software passano meno tempo sul coding di routine e più tempo con i clienti.

Anthropic nel frattempo ha pubblicato lo studio “Labor market impacts of AI” con una metrica che rende questi dati diversi da tutti quelli visti finora: la “observed exposure”, che non misura cosa l’AI potrebbe fare in teoria ma cosa sta effettivamente facendo, basandosi sui dati reali d’uso di Claude su circa 800 professioni americane. I settori meno esposti sono quelli fisici e manuali: Construction al 18%, Building & Grounds al 20%, Installation & Repair al 22%. I più esposti: Computer & Math al 94% teorico (33% già effettivo), Office & Administration al 90%, Business & Finance all’80%. A rischio quindi non l’operaio ma l’analista, non il muratore ma lo sviluppatore. Aumento della disoccupazione ancora no, ma un calo del 14% nelle assunzioni dei 22-25enni nelle professioni esposte sì. Anthropic | CBS News | Fortune | Fortune

L’AI CHE CURA

Ora un po’ di buone notizie, o presunte tali visto che si parla di malattie. L’AI sta aprendo nuovi fronti nella lotta alle malattie considerate incurabili.

Molti non lo sanno ma 1,1 milioni di persone muoiono ogni anno per infezioni che fino a poco tempo fa si curavano con un antibiotico qualunque, e il bilancio potrebbe superare gli otto milioni entro il 2050. Tra il 2017 e il 2022 sono stati approvati appena 12 nuovi antibiotici, quasi tutti simili a farmaci già esistenti, e questo per la lunghezza ed i costi della ricerca. Al MIT, James Collins ha addestrato così un modello generativo sulle strutture chimiche degli antibiotici noti e gli ha fatto generare 36 milioni di nuovi composti. Ne ha sintetizzati 24 in laboratorio: sette avevano attività antimicrobica, due si sono rivelati altamente efficaci contro gonorrea resistente e MRSA. Soprattutto, sembrano attaccare i batteri con meccanismi diversi dagli antibiotici esistenti — il che apre la strada a una possibile nuova classe di farmaci, la prima da decenni.

A Cambridge, Michele Vendruscolo affronta invece il Parkinson — oltre 10 milioni di pazienti nel mondo, nessun trattamento che ne rallenti la progressione in oltre un secolo di ricerca. Il suo team usa l’AI per trovare molecole capaci di legarsi ai corpi di Lewy, gli aggregati proteici coinvolti nella neurodegenerazione. Con i metodi tradizionali si vagliava un milione di molecole in sei mesi spendendo milioni di sterline; ora l’AI ne analizza miliardi in pochi giorni per poche migliaia. Il team inglese ha trovato cinque composti promettenti, più innovativi di quelli ottenibili con approcci convenzionali.

Alla Penn, David Fajgenbaum si è salvato la vita a 25 anni scoprendo che un farmaco anti-rigetto per trapiantati poteva curare la sua malattia di Castleman. Da quell’esperienza ha fondato Every Cure, una nonprofit che usa l’AI per incrociare migliaia di farmaci approvati con migliaia di malattie. Ad Harvard un modello ha trovato quasi 8.000 farmaci potenzialmente riutilizzabili per 17.000 patologie diverse, un filone particolarmente promettente per le malattie rare, ignorate dalle case farmaceutiche perché poco redditizie. A McGill hanno creato un “sistema di malattia virtuale” per la fibrosi polmonare idiopatica, testando farmaci virtuali sulla progressione simulata della malattia: tra gli otto candidati emersi c’è un comune antipertensivo, già sicuro e a basso costo. E Insilico Medicine ha portato in fase 2 di sperimentazione Rentosertib, farmaco interamente progettato dall’AI contro la stessa malattia.

La potenza dei modelli si scontra però con un problema di infrastruttura, e proprio nella guerra alla malattia che i padri fondatori dell’AI hanno promesso di risolvere, il cancro. Secondo Alicia Zhou del Cancer Research Institute, solo il 16% dei dati oncologici è pubblicamente disponibile, e meno dell’1% rispetta standard che ne permettano il riutilizzo. La ricerca non riproducibile costa 28 miliardi di dollari l’anno solo negli USA. Per questo il CRI ha lanciato il Discovery Engine insieme a Stanford, Penn e Memorial Sloan Kettering: un database condiviso e AI-ready per l’immunoterapia. L’obiettivo dichiarato: fare per la ricerca sul cancro quello che i grandi dataset hanno fatto per i modelli linguistici. BBC Future | World Economic Forum

L’AI CHE VERRÀ

Non so quanto si applicherà alla ricerca medica, ma c’è una notizia che mi ha colpito questa settimana. Riguarda i World Model, destinati secondo alcuni a superare i limiti strutturali dei modelli linguistici che comprendono il linguaggio ma non il mondo reale, e con cui mi ero congedato da voi salutando il 2025. Tra i sostenitori di questa tesi Yann LeCun, fino a poco fa capo dell’AI research di Meta, che ha raccolto 1,03 miliardi di dollari per AMI Labs, startup valutata 3,5 miliardi prima ancora di partire. Il fatto che colpisce è che AMI Labs ha sede a Parigi e il suo team è quasi interamente europeo. Tra gli investitori NVIDIA, Samsung, Toyota Ventures, Bezos Expeditions, Eric Schmidt. LeCun avverte: i world model richiedono ricerca fondamentale e anni prima di applicazioni commerciali, quindi dimenticatevi una startup di prodotto che in tre mesi fa il botto.

Chi il mondo reale lo cattura già è proprio l’ex datore di lavoro di LeCun, Meta, con i suoi Ray-Ban smart glasses (sette milioni di paia venduti nel 2025). Un’inchiesta dei giornali svedesi Svenska Dagbladet e Göteborgs-Posten ha rivelato dove finiscono tutti quei video: a data annotator di Sama, subappaltatore in Kenya, che li guardano fotogramma per fotogramma appunto per addestrare l’AI. Gli operatori passano ore a vedere di tutto, anche le persone al bagno sulla tazza, quelle che fanno sesso, o che leggono i numeri della loro carta di credito, tutto filmato da utenti che si dimenticano di vivere con una telecamera addosso. I volti dovrebbero essere sfocati automaticamente, ma gli addetti kenioti dicono che il sistema non funziona sempre. TechCrunch | TechCrunch

È tutto per oggi, alla prossima settimana.

Matteo M.

PS - Se vuoi altre newsletter come questa, dai un’occhiata a Newsletterati

![[humans/AI]](https://substackcdn.com/image/fetch/$s_!BwUp!,w_40,h_40,c_fill,f_auto,q_auto:good,fl_progressive:steep/https%3A%2F%2Fsubstack-post-media.s3.amazonaws.com%2Fpublic%2Fimages%2F5a903a45-5696-4fea-93ba-386d103ce0ec_1054x1054.png)

![[humans/AI]](https://substackcdn.com/image/fetch/$s_!MliX!,e_trim:10:white/e_trim:10:transparent/h_72,c_limit,f_auto,q_auto:good,fl_progressive:steep/https%3A%2F%2Fsubstack-post-media.s3.amazonaws.com%2Fpublic%2Fimages%2F6034ef7a-337e-475f-b232-ba4a9795a961_1600x631.jpeg)

La scuola è stata colpita da Israele ed è stata bombardata due volte. Una prima volta con le persone all'interno e poi quando i superstiti si sono radunati all'esterno sono stati colpiti direttamente. Un'azione pianificata, attuata il primo giorno dei bombardamenti, quando un piano militare colpisce i centri di controllo militari. Bombardare una scuola serviva a demoralizzare gli Iraniani. Ma il governo di Israele è composto da esseri inumani. E questo avrà conseguenze. Gli USA sono colpevoli di sostenere degli assassini a freddo di bambini. Gli USA non sono una società civilizzata. Sono primitivi appena usciti dalle caverne.

Mamma mia. Sembra il prequel di Dune.