Sulla superintelligenza.

Un epico post di Altman ci porta ad affrontare il tema della AI più intelligente di noi. Secondo il CEO di OpenAI è già qui, più o meno. Perché non credergli, perché credergli, cosa dicono gli altri

Hello human,

Oggi parleremo di superintelligenza, che vi piaccia o no (la citazione non è mia, lo scoprirete leggendo). Io sono Matteo Montan e se volete saperne di più su di me e su [humans/AI], trovate tutto nelle Info. E ora, andiamo!

Se l’AI fosse un’azienda, sarebbe sicuramente OpenAI.

Se fosse un prodotto, ChatGPT.

Un uomo: Sam Altman.

E Sam Altman, l’altro giorno, ha espresso il suo pensiero con un post cosiddetto epico dal titolo The Gentle Singularity, su cui oggi ci dilungheremo. Ma prima un paio di note di lettura.

Altman: è indiscutibilmente un genio, e senza di lui oggi probabilmente non sarei qui a scrivervi di AI. E’ un formidabile visionario. E’ l’erede naturale di Steve Jobs. Ma è anche un incredibile affabulatore che quando parla sa come dosare con sapienza sogno e incubo, riuscendo alla fine a fare prevalere il primo sul secondo, ma non senza prima avercela fatta fare un po’ sotto. Come per tutti i grandi venditori, quindi, occorre fare la tara a quello che dice. Ma anche con la tara, non puoi ignorare le cose che dice, perché di nuovo il merito, o la colpa, di tutto questo è in gran parte sua.

Singularity: è un un concetto che non corrisponde a quello italiano a cui tutti voi state pensando in questo momento. In Silicon Valley è più di una parola d’ordine (la diventerà anche qui) è una fede. Singularity è il modo intellettualmente corretto per riferirsi oggi alla superintelligenza artificiale, sin qui volgarmente acronimizzata in AGI (Artificial General Intelligence) o ASI (Artificial Super Intelligence). Comunque la si chiami, per Sam è arrivata, ed è gentile, quindi non deve fare paura, ma un po’ sì.

La Superintelligenza è già qui

The Gentle Singularity (link) è un lungo essay, e consiglio di leggerlo in originale, perché anche il linguaggio di Sam Altman è parte del pacchetto. Io ve lo riassumerò in in pillole rigorosamente tradotte a mano perché l’AI – che stimo moltissimo! – a scrivere è ancora meno brava di me, tiè. Buona lettura e ci vediamo dall’altra parte

**

Abbiamo superato il punto di non ritorno.

L'umanità sta per costruire la superintelligenza artificiale, ed è molto meno strana di quanto avremmo pensato: i robot non camminano per le strade, le persone muoiono ancora di malattie, non riusciamo ad andare facilmente nello spazio, e c'è molto dell'universo che non capiamo. Eppure, abbiamo costruito sistemi più intelligenti delle persone sotto molti aspetti e capaci di moltiplicare i risultati di chi li usa. La parte che meno probabilmente ci saremmo attesi che accadesse è alle nostre spalle, le intuizioni che ci hanno portato a sistemi come o3 (il modello più avanzato di OpenAI, ndr ) sono state vinte, e ora ci porteranno lontano.

La qualità della vita, grazie alla AI che accelera progresso scientifico e produttività saranno enormi.

In un certo senso, se ci pensate, ChatGPT è già ora più potente di qualsiasi essere umano mai vissuto: centinaia di milioni di persone vi si affidano ogni giorno, una sua piccola, nuova funzionalità può creare un impatto enormemente positivo, un piccolo disallineamento moltiplicato per centinaia di milioni di persone può causare un danno enorme.

Il 2025 è stato l’anno degli agenti e scrivere codice non sarà mai più come prima. Nel 2026 nuovi sistemi faranno fare nuove scoperte all’uomo. Il 2027 dovrebbe vedere l'arrivo di robot capaci di agire nel mondo reale. Ma gli anni '30 potrebbero essere selvaggiamente diversi da ogni tempo che li ha preceduti (wildly nel testo originale, ndr).

Le persone nuoteranno ancora nei laghi, ma intelligenza, energia e capacità di realizzare le idee diventeranno selvaggiamente abbondanti e grazie a questo, (e ad una buona governance), potremo teoricamente avere tutto il resto.

Già ora conviviamo con una intelligenza digitale che è incredibile, e dopo lo shock iniziale, la maggior parte di noi si è abituata. Siamo passati dall'essere stupiti che l’AI possa sviluppare un piccolo programma al chiederci quando potrà creare un'intera nuova azienda. È così che va la singolarità: le meraviglie diventano routine, e poi prerequisiti.

Niente è importate quanto potere usare l’AI per fare altra ricerca AI più velocemente. E se possiamo fare il lavoro di ricerca di un decennio in un mese, allora il ritmo del progresso sarà molto diverso.

Se occorre, faremo il primo milione di robot umanoidi alla vecchia maniera, ma poi loro potranno gestire tutta la supply chain, scavare e raffinare minerali, guidare camion, gestire fabbriche, così da costruire più robot, più fabbriche di chip, e datacenter, e allora il ritmo del progresso sarà ovviamente molto diverso. E automatizzando la produzione di datacenter, il costo dell'intelligenza alla fine sarà uguale al costo dell'elettricità.

Le persone, come è sempre successo, continueranno ad adattarsi al progresso tecnologico. Ci saranno intere classi di lavori che scompariranno, ma il mondo diventerà così velocemente ricco che potremo seriamente considerare nuove idee politiche che prima non potevamo immaginare. Non adotteremo un nuovo contratto sociale tutto in una volta, ma quando ci guarderemo indietro, l’insieme di questi cambiamenti sarà qualcosa di enorme.

Costruiremo cose sempre più meravigliose l'uno per l'altro, perché le persone hanno un vantaggio sull'AI: sono programmate per preoccuparsi delle altre persone, e non delle macchine.

Se un contadino vissuto mille anni fa guardasse quello che molti di noi fanno oggi direbbe che i nostri lavori sono finti e che stiamo solo giocando dato che abbiamo cibo in abbondanza e lussi inimmaginabili. Io credo che anche noi guarderemo i lavori tra mille anni nel futuro e penseremo che sono finti ma non ho dubbi che alle persone del futuro quei lavori sembreranno incredibilmente importanti e soddisfacenti, come pensiamo noi oggi dei nostri.

Oggi è difficile anche solo immaginare quello che avremo scoperto nel 2035: forse avremo iniziato la colonizzazione spaziale, avremo vere interfacce cervello-computer. Molte persone sceglieranno di vivere le loro vite più o meno allo stesso modo di oggi, ma altre decideranno di collegarsi (plug in, ndr) . Guardando avanti, tutto questo sembra difficile da immaginare, viverlo invece ci sembrerà incredibile ma gestibile, perché la singolarità accade pezzo per pezzo, e la fusione (tra noi e le macchine? ndr) avverrà lentamente. La curva esponenziale del progresso tecnologico sembra sempre verticale quando la si guarda in avanti ma piatta quando la si guarda all’indietro: immaginate di essere nel 2020 e pensate come ci sarebbe sembrato allora avere cinque anni dopo qualcosa vicino all'AGI, e poi pensate come sono stati davvero questi ultimi cinque anni.

Insieme agli enormi lati positivi, ci sono però grandi sfide da affrontare. Dobbiamo risolvere il problema dell'allineamento, per garantire un’AI che impara ed agisce in funzione di quello che vogliamo collettivamente a lungo termine, al contrario dei social media, l’esempio perfetto di AI disallineata, bravissima nel capire i tuoi bisogni a breve termine e a farti scrollare all’infinito, sovrascrivendo nel tuo cervello i bisogni a lungo termine.

Dobbiamo rendere la superintelligenza economica e universalmente disponibile, e non concentrata in poche persone, aziende, Paesi. La società è resiliente, creativa, e si adatta velocemente. Se sfrutteremo la volontà collettiva e la saggezza delle persone, anche se faremo errori e alcune cose andranno davvero male, impareremo e ci adatteremo velocemente e saremo in grado di usare questa tecnologia per massimizzare i lati positivi e minimizzare quelli negativi.

Sarà molto importante dare alle persone una grande libertà di utilizzo entro ampi confini, e prima il mondo inizierà la discussione su quali sono questi confini e su come definire l'allineamento collettivo, e meglio sarà.

Noi tutti, l’intera industry, non solo OpenAI, stiamo costruendo un cervello per il mondo. Sarà estremamente personalizzabile e facile da usare per tutti, e l’unico limite saranno solo le buone idee.

OpenAI è molte cose ora, ma prima di tutto, è un'azienda di ricerca sulla superintelligenza. Abbiamo molto lavoro davanti a noi, ma la maggior parte del percorso è luminoso, e ci sentiamo straordinariamente grati di poter fare quello che facciamo.

L'intelligenza ad un costo irrilevante è a portata di mano. Questo può sembrare folle da dire, ma se vi avessimo detto nel 2020 che saremmo stati dove siamo oggi, probabilmente sarebbe suonato più folle delle mie previsioni di oggi sul 2030.

Che tutti noi possiamo progredire dolcemente, esponenzialmente e senza incidenti verso la superintelligenza.

Amen, aggiungo io.

Ma quale superintelligenza (gli argomenti a-contrario)

Sicuramente molti leggendo penseranno: ma dai. Il problema delle allucinazioni dell’AI generativa in cui ci imbattiamo quotidianamente resta irrisolto e endemico (link) , così come l’insopportabile atteggiamento adulatorio (link) della quasi totalità dei chatbot con cui interagiamo (si chiama sycophancy, e come singularity è destinata a prendere posto nel nostro lessico).

Apple la scorsa settimana ha fatto uscire uno studio (link) nel quale sostiene che i modelli più avanzati, i reasoning model come gli ultimi di OpenAI , in realtà si perdono completamente nei loro pensieri quando vengono messi alla prova con problemi complessi. Va detto però che Apple da mesi vive una crisi senza precedenti di idee e di prodotto (link) ed è condannata a rincorrere gli altri sull’AI. Quindi i più malevoli (tanti, in verità) hanno visto nello studio intitolato L’illusione del ragionamento una riedizione cyborg della favola della volpe e l’uva. Chissà.

E Sundar Pichai, CEO di Google, che pure è un AI enthusiast (e come fare altrimenti, con ChatGPT che gli sta succhiando l’accesso al web dominato per 25 anni dal suo search) per descrivere l’attuale situazione dell’AI ha coniato un nuovo termine che almeno in italiano non suona benissimo: AJI, Artificial Jagged Intelligence (link), dove jagged sta per frastagliato, irregolare, a denti, insomma una parola che evoca qualcosa di non lineare, discontinuo, imprevedibile.

Perché prendere il capo di OpenAI sul serio

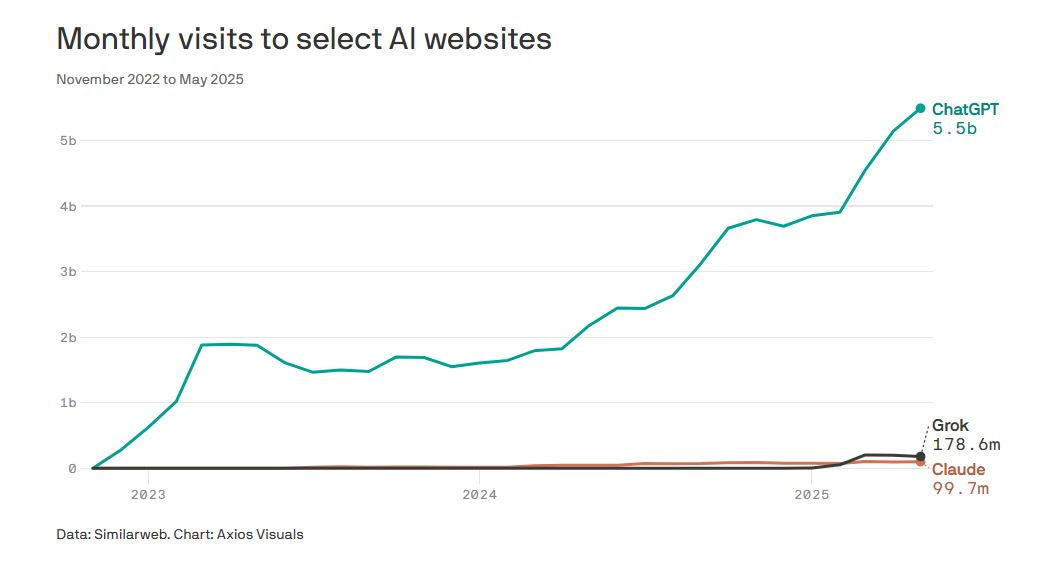

Ma attenzione: Altman è un uomo di pensiero e d’azione, e la sua azienda - OpenAI - è rapidissima (molto più degli altri: vedasi grafico sopra) nel tramutare le idee in prodotti, accordi, progetti, you name it.

La crescita della sua creatura ChatGPT non ha precedenti (link) e ora la sfida a Google è lanciata: l’ambizione di Altman è trasformare il suo prodotto di punta in assistente universale (link) e nuova interfaccia dell’umano medio per accedere a internet.

I numeri gli stanno dando ragione: a fine anno dovrebbe fatturare 12miliardi, più del doppio del 2024 (link) e nell’ultimo round di investimento da 40 miliardi ad una valorizzazione di 300, i dipendenti di OpenAI (5.400 al momento) secondo The information hanno venduto azioni e incassato 3 miliardi, che secondo la media del pollo vuol dire più di mezzo milione a testa contando i centralinisti.

Altman sta plasmando la prossima immensa tech consumer company con una visione eccezionalmente circolare: con il progetto Stargate da 500 billion entra nel mondo dei chip e datacenters; con l’ex braccio creativo di Steve Jobs annuncia un clamoroso ingresso nel mondo dei consumer device che irride apertamente Apple (link); la mattina fa patti con il diavolo Google (link) e la sera con l’acqua santa Barbie (link); si appresta a lanciare il suo sign-in universale con ChaptGPT (link) e progetta il robot che nella prossima era di internet infestata di agenti AI dovrà stabilire chi è umano e chi no (link)

Per di più, Sam Altman sa galleggiare a Washington meglio di chiunque altro nella Silicon Valley ed è sicuramente lui quello che ha forse provocato e sicuramente più beneficiato del divorzio Trump-Musk (link). Non secondario in questo momento storico in cui servono soldi per arrivare primi all’AGI, tanto che ieri ha piazzato un deal da 200 milioni col Governo (link)

Tranne uno, sulla superintelligenza gli esperti gli danno tutti ragione

Ci sono quindi tanti motivi per credere che Altman, fatta la tara di cui sopra, sa di cosa parla quando avvisa che la superintelligenza cambierà tutto, anche perché tutti i suoi colleghi founder di AI Lab, per miliardi di buoni motivi, la pensano ovviamente come lui, seppure con nuance diverse.

Il più vocal di tutti è il paladino dell’AI responsabile Dario Amodei (link), che da quando ha lasciato OpenAI per fondare Anthropic ha assunto il ruolo antagonista cupo di Altman: più Sam rafforza il suo posizionamento da Grande Ottimista (link), più Dario è costretto per differenza a ritagliarsi il ruolo di Grande Cassandra, preconizzando un AI potenzialmente assassina di masse e, da ultimo, un imminente bagno di sangue per milioni di colletti bianchi, affermazione che ha lasciato piuttosto perplessi anche alcuni suoi colleghi (link).

L’affascinante Sir Demis Hassabis, il britannico fondatore del lab Deepmind ora CEO di Google Deepmind (è lui la vera testa pensante della AI di Big G), è sicuro che la superintelligenza arriverà, e come data propende per il 2030 (link).

Il co-fondatore di OpenAI, Ilya Sutskever, che sta lanciando una sua startup che pronti-via senza prodotti e ricavi è valutata 30 miliardi solo sulla parola (si chiama Safe Super Intelligence) prendendo una laurea honoris causa recentemente ha detto: “Che vi piaccia o no, la superintelligenza presto ridefinirà a vita di ciascuno di noi (link)

Anche il buon Zuck, il quale ultimamente sull’AI non ne ha azzeccata una – dal modello LLama 4 sorpreso a barare nei benchmark alla privacy della sua AI app che fa acqua da tutte le parti (link) – adesso ha deciso di puntare tutto sulla superintelligenza ristrutturando completamente il team AI di Meta e comprandosi per 14 miliardi metà della start up Scale AI e, soprattutto, il suo talentuoso CEO Alexandr Wang a cui affidare il suo nuovo Superintelligence Lab (link).

Salendo di livello, Leone XIV, senza citare la superintelligenza nel suo suo primo discorso ai vescovi italiani (link) è tornato ad evocarla ed a manifestare la sua grande preoccupazione per lo sviluppo dell’AI, che secondo lui sta già trasformando profondamente la nostra percezione e la nostra esperienza della vita: “In questo scenario la dignità umana rischia di venire appiattita o dimenticata, sostituita da funzioni, automatismi, simulazioni”.

La posizione di chi non crede ad un arrivo imminente della superintelligenza è ormai largamente minoritaria, ed è appannaggio esclusivo del mondo accademico che diversamente dai Big Lab non sempre ha motivi finanziari per sostenerlo. Tra i più notati nelle ultime settimane Arvind Narayanan, professore di computer science alla Princeton University, che insieme ad un suo collega ha firmato uno studio dal titolo che di questi tempi suona quasi provocatorio: “AI as Normal Technology” (link).

A mio modesto parere (e di Azeem)

Personalmente, tendo più a pensarla come Azeem Azhar, che con il suo gruppo di ricerca Exponential Views continua ad impressionarmi per la lucidità, la profondità e rotondità con cui ci racconta la direzione tendenziale della tecnologia.

Dopo avere letto “The Gentle Singularity”, Azeem ha cercato di dare un senso alla parte più clamorosamente debole del pensiero di Altman, quella sulle sfide dell’AI e sulla governance, un compitino evidentemente messo lì solo per dovere d’ufficio, e pieno di concetti così naive da far pensare che gliel’abbia scritto ChatGPT.

“Sono d'accordo con Sam - – ha scritto Azhar - sulla direzione generale dell’AI. Meno sulla "gentilezza" della singolarità. Se le istituzioni non si adattano, se la governance non agisce in modo proattivo e se le persone non rivedono i loro modelli mentali, la singolarità sarà traumatica per molti. I governi soprattutto devono essere all'altezza della sfida. Alcuni stanno agendo, come i Paesi del Golfo che si stanno affrettando a riorganizzare istituzioni e infrastrutture,. Ma altri, vedi l'Europa, rimangono ancorati a presupposti pre-AI. Tocca alle democrazie guidare i cittadini attraverso questo sconvolgimento, perché i regimi non democratici non aspetteranno” (link).

Però. E’ tutto per oggi, ci sentiamo prossima settimana!

Matteo M.

PS Negli Stati Uniti, che almeno nominalmente sono ancora una democrazia, i Chief Technology Officer di OpenAI, Palantir e Meta hanno appena risposto ad una chiamata alle armi che il Pentagono aveva fatto qualche mese fa alla Silicon Valley, arruolandosi nella Riserva. Il gruppetto dei CTO in mimetica è già stato ribattezzato The Nerd Brigade (link)

PPS Se vuoi altre newsletter come questa, dai un’occhiata a Newsletterati

![[humans/AI]](https://substackcdn.com/image/fetch/$s_!BwUp!,w_80,h_80,c_fill,f_auto,q_auto:good,fl_progressive:steep,g_auto/https%3A%2F%2Fsubstack-post-media.s3.amazonaws.com%2Fpublic%2Fimages%2F5a903a45-5696-4fea-93ba-386d103ce0ec_1054x1054.png)

![[humans/AI]](https://substackcdn.com/image/fetch/$s_!MliX!,e_trim:10:white/e_trim:10:transparent/h_72,c_limit,f_auto,q_auto:good,fl_progressive:steep/https%3A%2F%2Fsubstack-post-media.s3.amazonaws.com%2Fpublic%2Fimages%2F6034ef7a-337e-475f-b232-ba4a9795a961_1600x631.jpeg)

![[humans/AI]](https://substackcdn.com/image/fetch/$s_!BwUp!,w_36,h_36,c_fill,f_auto,q_auto:good,fl_progressive:steep,g_auto/https%3A%2F%2Fsubstack-post-media.s3.amazonaws.com%2Fpublic%2Fimages%2F5a903a45-5696-4fea-93ba-386d103ce0ec_1054x1054.png)

Un post davvero ricchissimo di spunti, anche per i link collegati a riflessioni di approfondimento. Grazie

Molto bello, grazie